Il Senato approva decreto IA, ecco gli articoli che riguardano i medici di famiglia

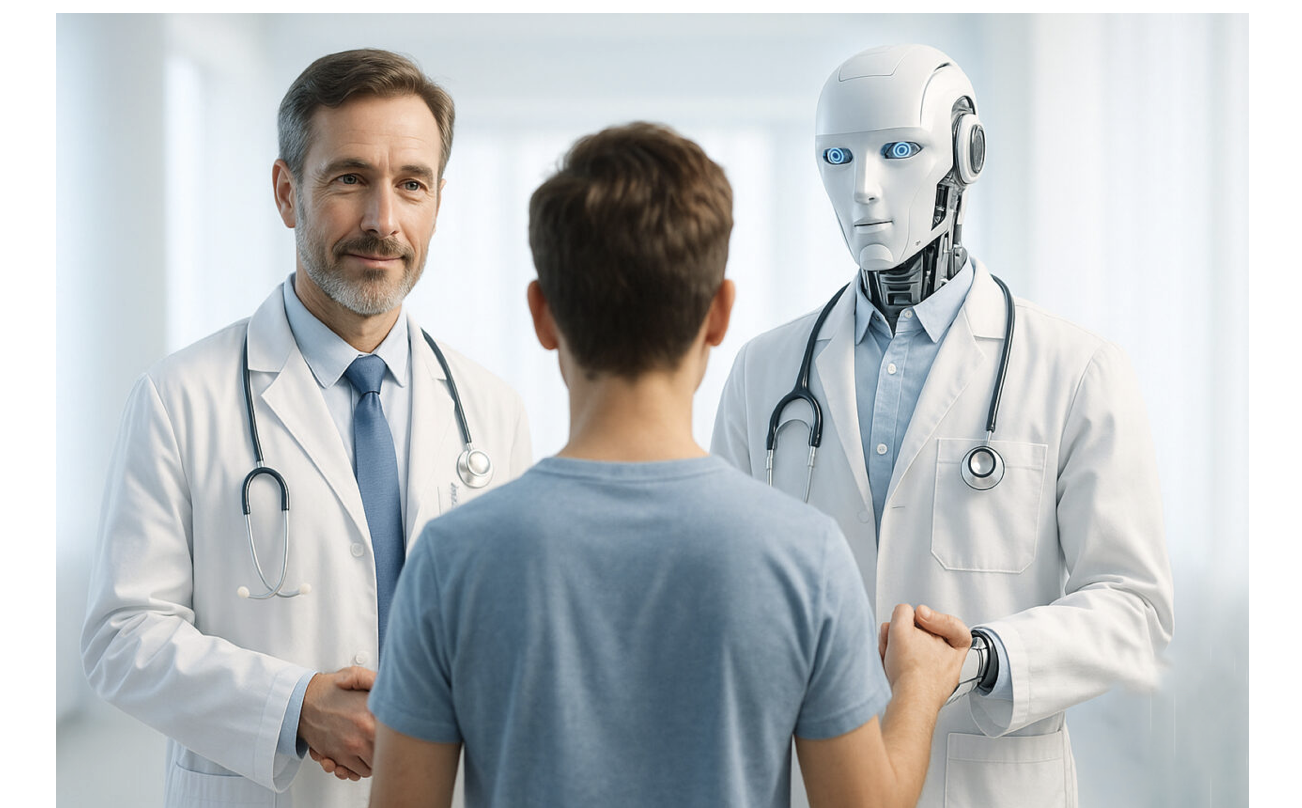

Il Senato ha approvato il decreto sull’Intelligenza Artificiale che prevede un quadro normativo nazionale per promuovere un uso trasparente e sicuro dell’IA, con particolare attenzione a innovazione, cybersicurezza, tutela dei dati. In sanità, l’IA è

Per la categoria dei medici di famiglia, il decreto prevede specifiche disposizioni negli articoli 7, 8, 9 e 10.

Articolo 7: L’IA in ambito sanitario è un supporto per prevenzione, diagnosi e cura, lasciando però la decisione finale ai medici. Deve rispettare i diritti della persona e la riservatezza, non può discriminare nell’accesso alle prestazioni sanitarie.

Articolo 8: relativo alla ricerca e sperimentazione scientifica sottolinea l’uso dei dati personali in modo responsabile per migliorare la ricerca e la cura, anche con sperimentazioni scientifiche e dati anonimizzati.

Articolo 9: il ministero della Salute, entro 120 giorni dall’entrata in vigore della legge, deve emanare un decreto per definire una disciplina semplificata del trattamento dei dati personali, compresi quelli particolari, finalizzata alla ricerca e sperimentazione nel settore sanitario. L’articolo riguarda anche l’uso dell’intelligenza artificiale nel fascicolo sanitario elettronico e nei sistemi di sorveglianza sanitaria, promuovendo l’adozione di soluzioni di IA a supporto dell’assistenza territoriale e della sanità digitale, coinvolgendo specificamente l’Agenzia nazionale per i servizi sanitari regionali

Articolo 10: I sistemi di IA per l’assistenza territoriale sono attuati attraverso una piattaforma AI della AGENAS che supporta i medici di famiglia e gli utenti, gestendo dati personali in modo conforme a privacy e sicurezza.

Il Presidente FNOMCeO, Anelli, ha dichiarato che “la Legge quadro sull’Intelligenza artificiale, approvata in via definitiva dal Senato, circoscrive in maniera chiara il perimetro di applicazione dell’IA in medicina. E, nel ribadire che l’IA è strumento

“Del testo abbiamo anche apprezzato – aggiunge Anelli – la promozione della ricerca e della formazione, e gli interventi sul Codice penale che prevedono la punibilità degli utilizzi illeciti, tra cui i deepfake. La FNOMCeO è stata tra i primi a denunciare l’uso distorto dell’IA per generare video in cui medici più o meno noti a livello mediatico pubblicizzavano prodotti o diffondevano false notizie in tema di salute; altrettanto condannabile riteniamo l’utilizzo di deepfake che mettano a rischio la dignità delle persone”.

Testo approvato dal Senato Atto Senato n. 1146

Nota: Un deepfake è un contenuto (video, audio o immagine) creato o modificato tramite intelligenza artificiale (IA) e deep learning, che rende indistinguibile il falso dall’autentico, permettendo di far apparire persone che dicono o fanno cose che non hanno mai detto o fatto.

Dalla relazione di presentazione del Disegno di Legge

La finalità del presente disegno di legge è di porre al centro di ogni attività che riguardi lo sviluppo e

l’utilizzo dei sistemi e dei modelli di intelligenza artificiale l’autodeterminazione umana.

Porre al centro dello sviluppo e della concreta applicazione dei sistemi e dei modelli di IA il rispetto

della autonomia e del potere decisionale dell’uomo consente di adottare scelte consapevoli su come

delegare le decisioni ai sistemi di IA. In tutto il ciclo di vita dei sistemi dei modelli di IA occorre

che sia l’essere umano a stabilire quali decisioni prendere e come realizzare un risultato vantaggioso

per la società.

Consapevolezza, responsabilità e affidabilità quali espressione del diritto fondamentale della persona

di autodeterminarsi, con coscienza e pensiero critico, in ogni ambito in cui è coinvolta dalle tecnologie

digitali.

Di qui, la scelta di prevedere una serie di norme di principio collegate alle finalità e all’ambito di

applicazione dell’intero disegno di legge e che si innestano, in modo differenziato, a seconda dei

singoli settori, nelle diverse fasi del ciclo di vita dell’intelligenza artificiale, dalla ricerca fino

all’adozione e al concreto utilizzo dei sistemi e dei modelli di intelligenza artificiale.

L’effettività di tale normativa di principio è sancita non solo dalla loro stessa enucleazione in fonte

primaria ma dall’espressa previsione (art. 1, comma 2) secondo cui tutte le disposizioni del disegno

di legge “devono essere interpretate e applicate conformemente al diritto dell’Unione europea”, in

ossequio, peraltro, all’art. 117, comma 1, della Costituzione.

Si stabilisce che nelle professioni intellettuali il pensiero critico umano debba sempre risultare prevalente rispetto all’uso degli strumenti di intelligenza artificiale che può riguardare solo le attività di supporto all’attività professionale. Per assicurare il rapporto fiduciario tra professionista e cliente si è stabilito, inoltre, che le informazioni relative ai sistemi di intelligenza artificiale utilizzati dal professionista debbano essere comunicate al cliente con linguaggio chiaro, semplice ed esaustivo.

Si applica inoltre il principio antropocentrico all’utilizzo dell’IA nel mondo del lavoro, chiarendo che l’intelligenza artificiale può essere impiegata per migliorare le condizioni di lavoro, tutelare l’integrità psicofisica dei lavoratori, accrescere la qualità delle prestazioni lavorative e la produttività delle persone in conformità al diritto dell’Unione europea (comma 1). Ciò comporta che ogni utilizzo dell’intelligenza artificiale in ambito lavorativo debba essere sicuro, affidabile, trasparente e non può svolgersi in contrasto con la dignità umana né violare la riservatezza dei dati personali e che datore di lavoro o il committente è tenuto a informare il lavoratore dell’utilizzo dell’intelligenza artificiale